Vigilancia predictiva

Durante más de un siglo, la policía ha intentado encontrar formas de predecir dónde, cuándo y quién va a cometer un delito. En el siglo XXI, esta ambición adopta a menudo la forma de algoritmos predictivos que utilizan datos históricos en un intento de anticipar acontecimientos futuros. La policía suele introducir datos tan dispares como información sobre el tráfico, estadísticas de delincuencia e informes de incidentes, o incluso las notas de los alumnos. Los resultados algorítmicos suelen orientar los procedimientos policiales, las patrullas e incluso a quién someter a mayor vigilancia.

Pero, por supuesto, la policía no puede predecir la delincuencia, con o sin ordenador. Nadie puede ver el futuro. Lo que sí puede hacer la policía, sin embargo, es hacer suposiciones sobre quién y dónde es más probable que se produzcan delitos y someter a esos lugares y personas a un intenso escrutinio. Esta mayor vigilancia puede dar lugar a un aumento de las paradas en el tráfico y en las aceras, a la documentación de las actividades de una persona a lo largo del tiempo e incluso al uso de la fuerza.

La policía predictiva es a menudo una profecía autocumplida. Si la policía concentra sus esfuerzos en un barrio y detiene a docenas de personas en el transcurso de una semana, los datos pueden reflejar que esa zona es un foco de actividad delictiva, lo que lleva al algoritmo a desplegar más agentes allí la semana siguiente. El sistema también tiene en cuenta únicamente los delitos denunciados, por lo que los barrios en los que la policía recibe más llamadas podrían ver cómo la tecnología policial predictiva concentra allí sus recursos. Este sistema puede agravar las pautas existentes de actuación policial -especialmente en barrios con concentraciones de personas de color, personas sin vivienda e inmigrantes- utilizando el manto de la legitimidad científica y la supuesta naturaleza imparcial de los datos.

Cómo funciona

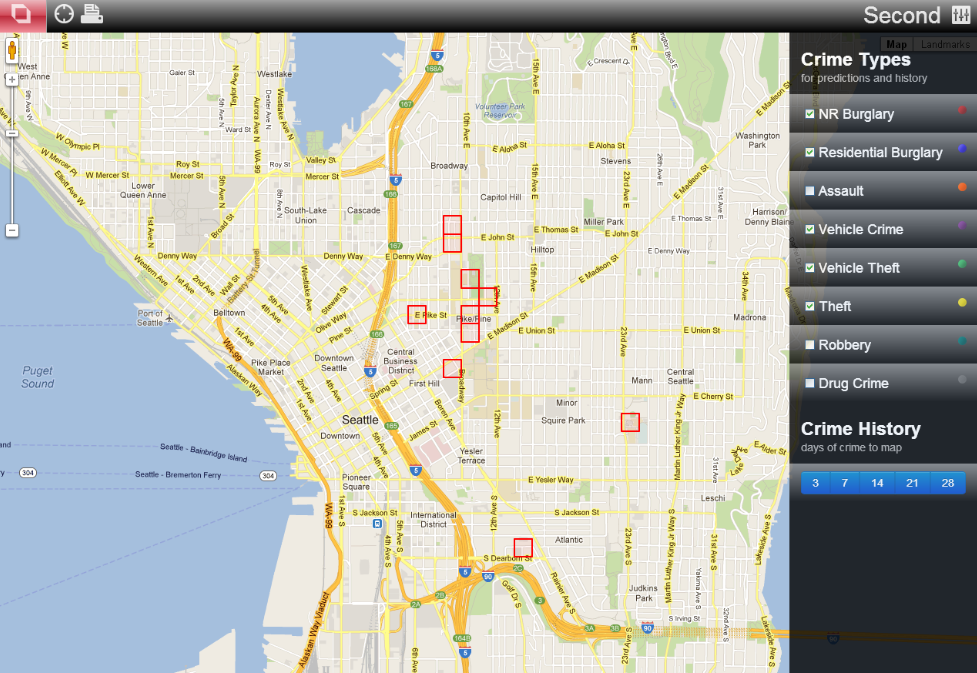

Los programas de predicción policial suelen funcionar introduciendo datos sobre delincuencia, y a veces cantidades ingentes de otros datos, en un algoritmo que trata de buscar patrones invisibles que puedan revelar dónde y cuándo es más probable que se cometan delitos. Esa información puede incluir, por ejemplo, la localización de todos los delitos registrados por la policía, la hora a la que se cometieron o incluso el tiempo. El modelo predictivo puede configurar el despliegue de las patrullas.

En algunos casos, este tipo de programas pueden centrarse en individuos. En el condado de Pasco (Florida), la policía asignó un sistema de puntos a las personas en función de factores como el nivel de ingresos de la familia o sus calificaciones, con el fin de asignar un nivel de probabilidad de que un menor cometiera delitos, y luego acosarlo a él y a su familia.

Cómo lo utilizan las fuerzas de seguridad

Las fuerzas del orden suelen afirmar que la policía predictiva es un "multiplicador de fuerza", algo que permite a los departamentos asignar agentes y recursos de forma más estratégica. Esto significa que la policía introduce datos en un software que identifica patrones que la policía espera que dicten dónde deben desplegar a los agentes para prevenir la actividad delictiva. Esto puede adoptar la forma de "mapas de calor" que muestran las manzanas de la ciudad que supuestamente tendrán niveles de delincuencia más altos de lo normal, seguidos del despliegue de agentes en esas manzanas.

Quién lo vende

PredPol, ahora llamada Geolitica, fue uno de los primeros proveedores de policía predictiva. Inició un programa piloto en el Departamento de Policía de Santa Cruz en 2011. En 2020, algunos departamentos de policía comenzaron a cancelar sus contratos en medio de la preocupación pública por las libertades civiles. Los Ángeles puso fin a su suscripción. Santa Cruz y Nueva Orleans prohibieron por completo el uso de algoritmos policiales predictivos (aunque Nueva Orleans ha retirado desde entonces estas protecciones).

En 2018, se informó de que Palantir, una empresa que a menudo trata de ayudar a los organismos a organizar y visualizar grandes conjuntos de datos, estaba probando un sistema policial predictivo en Nueva Orleans sin el conocimiento de los funcionarios electos. Banjo, que mantuvo brevemente un contrato multimillonario con el estado de Utah, fue finalmente declarada por una auditoría gubernamental incapaz de prestar los servicios que había ofrecido al estado y se le dio acceso a bases de datos estatales que contenían información sensible.

Algunos departamentos de policía trabajan con proveedores para crear su propia versión de esta herramienta, como los sistemas de concienciación de dominios de la policía de Nueva York y Microsoft. Además, proveedores conocidos por otros tipos de tecnología de vigilancia se están introduciendo en el mercado de la policía predictiva. En 2018, ShotSpotter, una empresa que vende detección acústica de disparos, adquirió una empresa llamada HunchLab con la esperanza de decirle a la policía dónde podrían ocurrir disparos en el futuro.

Amenazas de la policía predictiva

Durante al menos un siglo, los departamentos de policía han utilizado estadísticas y cartografía en un intento de comprender dónde y cuándo podría producirse la delincuencia, pero los retos que propone la tecnología digital plantean nuevas amenazas para las libertades civiles. Nadie debería ver mermados sus derechos constitucionales por vivir o transitar por zonas en las que un algoritmo haya predicho que habrá delincuencia.

También preocupa mucho el tipo de datos que se introducen en estos programas. Cada vez se introducen más tipos de datos personales sensibles sobre las personas. También existe el gran problema de los datos sesgados generados por los departamentos de policía. Por ejemplo, si la policía somete a los barrios de mayoría negra a un intenso escrutinio y vigilancia, será más probable que efectúe identificaciones y detenciones por infracciones menores contra la calidad de vida que en otros barrios. Por lo tanto, los mapas derivados que pretenden mostrar dónde podrían cometerse delitos en el futuro tendrán un peso desproporcionado en aquellos barrios que ya viven bajo el peso de una intensa presencia policial. Esto puede crear una profecía autocumplida que utiliza la supuesta objetividad de las matemáticas para legitimar procedimientos policiales con sesgo racial.

Las agencias policiales y los proveedores también afirman que pueden entrenar algoritmos de aprendizaje automático para predecir si una persona es propensa a cometer delitos. Una afirmación especialmente dudosa es que esto puede hacerse analizando los atributos físicos del rostro de una persona.

Trabajo de la EFF relacionado con la policía predictiva

Debido al riesgo que supone para las libertades civiles y las poblaciones vulnerables, la EFF aboga por prohibir la vigilancia policial predictiva. También aplaudimos a los legisladores que quieren desempeñar un papel más activo en la investigación de los proveedores de servicios policiales predictivos y los departamentos de policía. Seguiremos apoyando a los legisladores de ciudades, estados o gobiernos nacionales en sus intentos de frenar esta peligrosa tecnología.

Lecturas adicionales sugeridas

https://repository.law.umich.edu/mjlr/vol55/iss4/3/

https://theintercept.com/2021/01/30/lapd-palantir-data-driven-policing/

https://www.wired.com/story/crime-prediction-racist-history/